- Reportes de transparencia obligatorios: Antes de desplegar un nuevo modelo o una actualización significativa, las empresas con ingresos superiores a $500 millones (como OpenAI, Google, Meta y Anthropic) deben publicar informes detallados sobre sus protocolos de seguridad y mitigación de riesgos. Estos documentos incluirán evaluaciones de riesgos catastróficos, idiomas y modalidades soportadas, usos permitidos y restricciones, y si se involucraron evaluadores externos.

- Reporte de incidentes críticos: Las compañías deben notificar a la Oficina de Servicios de Emergencia de California (OES) cualquier incidente de seguridad grave dentro de 15 días (o 24 horas si implica daño inminente). A partir de 2027, la OES publicará resúmenes anuales anonimizados de estos eventos.

- Protecciones para denunciantes: Se crean salvaguardas contra represalias para empleados que revelen riesgos significativos a la salud o seguridad, con penas civiles de hasta $1 millón por incumplimiento, ejecutables por el fiscal general.

- Actualizaciones anuales y CalCompute: El Departamento de Tecnología de California recomendará ajustes a la ley basados en aportes multistakeholder, avances tecnológicos e estándares internacionales. Además, se establece CalCompute, un clúster de computación en la nube pública para democratizar el acceso a infraestructura de IA para startups e investigadores, fomentando la equidad y la sostenibilidad.

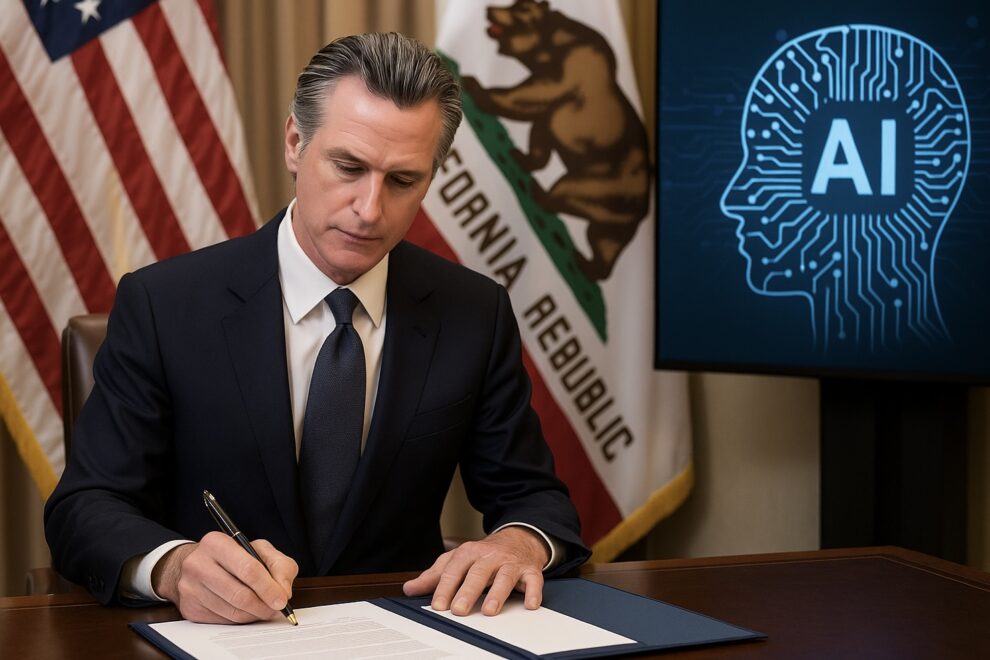

Newsom destacó que “California ha demostrado que podemos establecer regulaciones para proteger a nuestras comunidades mientras aseguramos que la industria de IA siga prosperando”. El senador Scott Wiener, autor de la ley, la describió como “guardarraíles de sentido común” que posicionan al estado como líder global en innovación segura. Empresas como Anthropic han aplaudido el marco, argumentando que previene que la competencia erosione los esfuerzos voluntarios de seguridad, aunque gigantes como Meta y Google expresaron preocupaciones iniciales por posibles “parches regulatorios” estatales.

|

País/Región

|

Marco Principal

|

Enfoque Clave

|

Estado en 2025

|

|---|---|---|---|

|

Unión Europea

|

AI Act (Reglamento 2024/1689)

|

Clasifica IA por riesgo (prohibida, alta, limitada, mínima); obliga a mitigación en modelos de propósito general (GPAI).

|

En vigor: prohibiciones desde febrero; obligaciones para GPAI desde agosto. Multas hasta 7% de ingresos globales.

|

|

China

|

Ley de IA (borrador 2024) + marcos sectoriales

|

Enfoque centralizado y ético; regula algoritmos, deepfakes y contenido sintético; prioriza “IA para el bien común” bajo supervisión gubernamental.

|

En expansión: guías para identificación de IA generativa (marzo 2025); énfasis en seguridad nacional y ética.

|

|

Reino Unido

|

Marco de IA (no vinculante) + Ley de Seguridad en Línea

|

Enfoque pro-innovación; regulaciones sectoriales con énfasis en transparencia y riesgos.

|

Activo: posible AI Act propio influido por UE; énfasis en colaboración público-privada.

|

|

Canadá

|

Artificial Intelligence and Data Act (AIDA, Bill C-27)

|

Risk-based; integra privacidad de datos; obliga a evaluaciones de impacto en IA de alto riesgo.

|

Retrasado: “muerto” en comité en enero 2025; se espera reintroducción y entrada en vigor no antes de 2026.

|

|

Brasil

|

Proyecto de Ley de IA (No. 2338/2023)

|

Risk-based similar a UE; prohíbe IA de riesgo excesivo; crea ente regulador y responsabilidad civil.

|

Aprobado en Senado (diciembre 2024); pendiente en Cámara; uno de los primeros en América Latina.

|

|

Otros (ej. India, Japón, Corea del Sur)

|

Estrategias nacionales + guías

|

India: énfasis en innovación sin ley integral; Japón/Corea: colaborativos, con regulaciones éticas y de alto riesgo.

|

En desarrollo: Japón con centros de soporte para GPAI; Corea con marco comprehensivo alineado a UE.

|

Estos marcos globales subrayan una tendencia hacia la armonización, con la UE como referente, pero adaptaciones locales para equilibrar innovación y riesgos. En México y California, el énfasis en transparencia y equidad podría inspirar colaboraciones regionales, especialmente en Norteamérica.

Add Comment